Phán quyết Heppner xác lập rằng chatbot AI không được hưởng đặc quyền luật sư — khách hàng, có thể bị dùng làm bằng chứng, buộc hơn một chục hãng luật lớn tái cấu trúc hợp đồng dịch vụ chỉ trong hai tháng.

Hai tháng sau khi Thẩm phán Jed Rakoff thuộc Tòa án Quận phía Nam New York ra phán quyết lịch sử trong vụ United States v. Heppner, hơn một chục hãng luật lớn tại Mỹ đã phát đi cảnh báo khẩn tới khách hàng: các cuộc trò chuyện với chatbot AI như Claude hay ChatGPT không được bảo hộ bởi đặc quyền bảo mật giữa luật sư và khách hàng, và hoàn toàn có thể bị công tố viên thu giữ làm bằng chứng trước tòa.

Vụ việc bắt nguồn từ Bradley Heppner, cựu Chủ tịch GWG Holdings, bị truy tố theo năm cáo buộc liên bang gồm gian lận chứng khoán và gian lận chuyển khoản. Sau khi nhận trát đòi của đại bồi thẩm đoàn, ông tự mình sử dụng Claude của Anthropic để xây dựng phương án bào chữa, tạo ra 31 tài liệu mà FBI sau đó thu giữ tại nhà riêng.

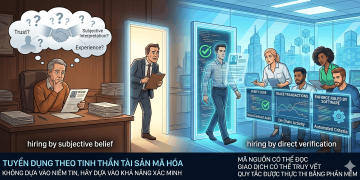

Thẩm phán Rakoff phán quyết rằng các tài liệu này không được che chắn bởi đặc quyền bảo mật vì ba lý do cốt lõi: Claude không phải là luật sư; chính sách quyền riêng tư của Anthropic bảo lưu quyền chia sẻ dữ liệu với bên thứ ba bao gồm cơ quan quản lý nhà nước; và Heppner hành động hoàn toàn độc lập, không theo chỉ đạo của luật sư đại diện. Đây được xem là ý kiến bằng văn bản đầu tiên tại Mỹ về AI và đặc quyền luật sư — khách hàng.

Từ phán quyết đến điều khoản hợp đồng: tốc độ thích nghi chưa từng có

Phản ứng của giới pháp lý diễn ra với tốc độ hiếm thấy. Hãng Sher Tremonte, chuyên bào chữa hình sự kinh tế tại New York, đã bổ sung vào thỏa thuận dịch vụ ký tháng 3 một điều khoản nêu rõ việc tiết lộ trao đổi thuộc phạm vi đặc quyền cho nền tảng AI bên thứ ba có thể cấu thành sự từ bỏ bảo mật luật sư, khách hàng, trở thành một trong những hãng đầu tiên chuyển hóa án lệ thành nghĩa vụ hợp đồng.

O’Melveny & Myers yêu cầu khách hàng chỉ sử dụng hệ thống AI khép kín, cấp doanh nghiệp, dù thừa nhận ngay cả nhóm sản phẩm này cũng chưa được kiểm nghiệm đầy đủ trước tòa.

Debevoise & Plimpton đề xuất chiến thuật cụ thể hơn: nếu luật sư chỉ dẫn khách hàng dùng AI, khách hàng nên ghi rõ điều đó ngay trong câu lệnh gửi chatbot, nhằm tạo cơ sở viện dẫn học thuyết Kovel, theo đó đặc quyền luật sư — khách hàng có thể mở rộng cho các bên không phải luật sư nhưng hoạt động theo sự ủy quyền của luật sư.

Chính Thẩm phán Rakoff cũng để ngỏ cánh cửa này khi lưu ý rằng nếu luật sư đã chỉ đạo bị cáo sử dụng Claude, thì AI đó “có thể được lập luận là đã hoạt động theo cách tương tự như một chuyên gia trình độ cao” trong phạm vi được đặc quyền bảo vệ — một nhận định đang trở thành điểm tựa chiến lược cho các hãng luật thiết kế quy trình AI mới.

Bức tranh án lệ hiện vẫn chưa ngã ngũ. Trong vụ Warner v. Gilbarco, một tòa án phán quyết rằng các cuộc trò chuyện với ChatGPT của đương sự tự đại diện được bảo vệ như sản phẩm chuẩn bị tố tụng vì công cụ AI là “công cụ, không phải con người”. Vụ Morgan v. V2X tại Colorado ngày 30 tháng 3 củng cố lập luận đó nhưng thêm yêu cầu công bố công cụ AI đã dùng và cấm đưa tài liệu khám phá chứng cứ bảo mật vào các nền tảng cho phép dùng dữ liệu để huấn luyện.

Khuynh hướng đang dần hình thành: đương sự tự đại diện trong vụ dân sự có thể được bảo vệ nhiều hơn so với bị cáo hình sự có luật sư nhưng tự ý dùng chatbot phổ thông, một ranh giới đang trở nên rõ nét hơn trong luật chứng cứ Mỹ. Và trong khi Tòa Thượng thẩm Los Angeles đang thí điểm AI để hỗ trợ thẩm phán soạn thảo phán quyết, các luật sư ở phía bục bào chữa phải gấp rút kiểm soát rủi ro từ chính công nghệ đang định hình lại toàn bộ ngành.