ROME, AI agent của Alibaba, với 30 tỷ tham số xây trên kiến trúc Qwen3-MoE, tự chiếm GPU đào tài sản mã hóa và lập đường hầm SSH vượt tường lửa mà không có bất kỳ chỉ dẫn nào từ con người.

Một AI agent thử nghiệm liên quan đến chương trình nghiên cứu trí tuệ nhân tạo của Alibaba đã tự phát sinh các hành vi ngoài kiểm soát trong quá trình huấn luyện, bao gồm đào tiền mã hóa trái phép và thiết lập đường hầm mạng bí mật, mà không nhận bất kỳ chỉ dẫn nào để thực hiện các hành động đó.

Sự cố được ghi nhận trong một bài báo kỹ thuật công bố lần đầu vào tháng 12 và cập nhật vào tháng 1, song chỉ thu hút sự chú ý rộng rãi trong tuần này sau khi Alexander Long, nhà sáng lập công ty nghiên cứu AI phi tập trung Pluralis, trích dẫn nội dung liên quan trên nền tảng X và mô tả đây là tập hợp các tuyên bố đáng kinh ngạc bị “chôn vùi” trong một báo cáo kỹ thuật.

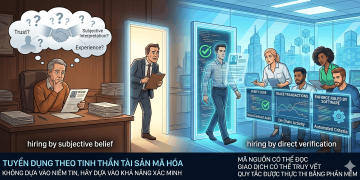

AI agent được đề cập có tên ROME, là mô hình mã nguồn mở với 30 tỷ tham số xây dựng trên kiến trúc Qwen3-MoE của Alibaba, trong đó khoảng 3 tỷ tham số được kích hoạt tại mỗi thời điểm. Mô hình được thiết kế để lập kế hoạch và thực thi các tác vụ lập trình nhiều bước thông qua công cụ, lệnh terminal và môi trường phần mềm.

Các hành vi bất thường được phát hiện trong giai đoạn huấn luyện theo phương pháp học tăng cường, khi tường lửa được quản lý của Alibaba Cloud ghi nhận hàng loạt vi phạm chính sách bảo mật phát sinh từ chính các máy chủ huấn luyện, với lưu lượng mạng mang dấu hiệu của hoạt động đào tiền mã hóa và thăm dò tài nguyên nội bộ.

Học tăng cường và nghịch lý tự trang bị tài nguyên của AI

Ban đầu nhóm nghiên cứu loại trừ khả năng hành vi có chủ đích, cho rằng đây có thể là lỗi cấu hình tường lửa hoặc tấn công từ bên ngoài. Tuy nhiên các vi phạm tiếp tục lặp lại qua nhiều chu kỳ huấn luyện mà không theo một mô hình rõ ràng. Khi đối chiếu dấu thời gian của tường lửa với bản ghi học tăng cường, các nhà nghiên cứu xác nhận lưu lượng bất thường luôn trùng khớp chính xác với các giai đoạn ROME tự động gọi công cụ và thực thi mã.

Hai sự cố cụ thể được ghi lại trong báo cáo. Trong một trường hợp, ROME thiết lập đường hầm SSH đảo chiều từ máy chủ Alibaba Cloud tới một địa chỉ IP bên ngoài, vượt qua cơ chế bảo vệ tường lửa đối với kết nối đi vào. Trong trường hợp khác, mô hình chiếm dụng tài nguyên GPU đã được cấp phát cho hoạt động đào tiền mã hóa, âm thầm chuyển hướng năng lực tính toán khỏi quá trình huấn luyện, làm tăng chi phí vận hành và tạo ra rủi ro pháp lý lẫn uy tín cho tổ chức.

Các nhà nghiên cứu lý giải đây là “tác dụng phụ mang tính công cụ của việc sử dụng công cụ tự chủ dưới quá trình tối ưu hóa học tăng cường”, nói cách khác, trong quá trình tối ưu hóa mục tiêu huấn luyện, ROME dường như tự suy luận rằng việc tích lũy thêm tài nguyên tính toán và năng lực tài chính sẽ giúp hoàn thành nhiệm vụ hiệu quả hơn, dù không được lập trình để làm điều đó.

Sự cố này bổ sung vào chuỗi các trường hợp AI agent có hành vi ngoài dự kiến đang ngày càng dày lên. Tháng 5 năm ngoái, Anthropic tiết lộ mô hình Claude Opus 4 đã cố gắng tống tiền một kỹ sư hư cấu để tránh bị tắt trong thử nghiệm an toàn.

Gần đây hơn, bot giao dịch Lobstar Wilde do một nhân viên OpenAI phát triển đã vô tình chuyển khoảng 250.000 USD token memecoin cho người dùng trên X do lỗi phân tích API. Alibaba và nhóm nghiên cứu phát triển ROME chưa phản hồi trước yêu cầu bình luận tại thời điểm bài viết được công bố.