AI có thể trở thành công cụ hữu ích cho tội phạm trong hệ sinh thái tiền mã hoá, và việc hiểu rõ các xu hướng tội phạm mới là rất quan trọng để bảo vệ ngành công nghiệp này.

Với sự phát triển nhanh chóng của trí tuệ nhân tạo (AI), đã có nhiều sáng kiến đổi mới mang lại lợi ích lớn trong nhiều ngành công nghiệp, đặc biệt là lĩnh vực tiền mã hoá. Tuy nhiên, như bất kỳ công nghệ mới nào, AI cũng mang theo nguy cơ bị lợi dụng vào các mục đích xấu. Theo báo cáo do Elliptic thực hiện, tổ chức này đã xác định năm loại tội phạm mới nổi trong hệ sinh thái tiền mã hoá được hỗ trợ bởi AI.

AI tạo dựng lừa đảo deepfake trong tiền mã hoá

AI đang được sử dụng để tạo ra các chiêu lừa đảo trong tiền mã hoá. Cụ thể, các video deepfake giả mạo người nổi tiếng hoặc các lãnh đạo doanh nghiệp đang quảng bá các dự án đầu tư tiền mã hoá, tạo ra ấn tượng rằng dự án này có sự hỗ trợ chính thức. Ví dụ như các video giả mạo CEO của Ripple, Brad Garlinghouse, đã xuất hiện để lừa đảo người dùng tham gia vào các trò lừa đảo tặng tiền mã hoá.

Các chiêu lừa đảo này thường sử dụng hình ảnh, video và giọng nói được tạo ra bởi AI để làm cho các trang web lừa đảo trông thuyết phục hơn. Một ví dụ điển hình là vụ tấn công Twitter vào tháng 7/2020, khi các tài khoản của nhiều người nổi tiếng bị hack để đăng các liên kết lừa đảo tặng Bitcoin. Trong nhiều trường hợp, những kẻ lừa đảo còn sử dụng tài khoản quản trị viên trên các kênh Discord của các dự án tiền mã hoá để đăng các liên kết lừa đảo, đánh cắp tiền mã hoá hoặc các token không thể thay thế (NFT).

Tạo token AI lừa đảo hoặc các kế hoạch thao túng thị trường

Một số lượng lớn token lừa đảo đã được tạo ra với các từ khóa liên quan đến AI như “GPT”, “CryptoGPT”, và “GPT Coin”. Những token này thường được quảng bá trên các diễn đàn giao dịch nghiệp dư, tạo ra sự hứng thú giả tạo và cuối cùng là lừa đảo người dùng bằng cách bán token và biến mất với số tiền thu được. Các chiêu lừa đảo này bao gồm “exit scams” (lừa đảo rút lui) và “pump and dump” (thao túng thị trường).

Theo báo cáo của Elliptic, trên nhiều blockchain, việc tạo ra một token là rất dễ dàng, và những kẻ lừa đảo đã lợi dụng điều này để tạo ra các token liên quan đến AI nhằm tạo ra sự hứng thú giả tạo. Các token này thường được quảng bá trong các diễn đàn giao dịch nghiệp dư, nơi mà những kẻ lừa đảo tuyên bố có sự liên kết chính thức với các công ty AI hợp pháp như ChatGPT hoặc các công ty AI khác. Những chiêu lừa đảo này không chỉ dừng lại ở việc tạo ra token, mà còn bao gồm các nền tảng đầu tư giả mạo, các bot giao dịch AI giả mạo và các chiêu lừa đảo thoát hiểm (exit scams).

Một ví dụ điển hình là vụ lừa đảo bot giao dịch AI trị giá 6 triệu USD mang tên “iEarn”, trong đó những kẻ lừa đảo tạo ra một nền tảng giao dịch AI giả mạo và sau đó biến mất với số tiền đầu tư của nạn nhân. Những kẻ lừa đảo này thường tái xuất hiện dưới các tên gọi và trang web khác nhau, tiếp tục lừa đảo các nạn nhân mới. Một ví dụ nổi bật khác là Mirror Trading International (MTI), một mô hình Ponzi đã thu về hơn 1,7 tỷ USD tiền mã hoá từ các nạn nhân trên toàn thế giới.

Sử dụng các mô hình ngôn ngữ lớn để thực hiện các cuộc tấn công mạng

Công cụ AI như ChatGPT có khả năng kiểm tra và phát hiện lỗ hổng trong mã code, do đó có thể bị khai thác bởi hacker để tìm ra và tấn công các hợp đồng thông minh của các giao thức tài chính phi tập trung (DeFi). Một số công cụ AI “phi đạo đức” đã được quảng bá trên các diễn đàn web đen với khả năng tự động hoá các email lừa đảo, viết mã độc và tìm lỗ hổng.

Ví dụ, các hacker có thể sử dụng AI để kiểm tra mã nguồn mở của nhiều giao thức DeFi trong một khoảng thời gian ngắn để tìm ra các lỗ hổng bảo mật. Một số công cụ AI “phi đạo đức” như WormGPT, DarkBard, FraudGPT và HackerGPT đã được quảng bá trên các diễn đàn web đen với khả năng tự động hoá các hoạt động tội phạm mạng như gửi email lừa đảo, viết mã độc và tìm lỗ hổng bảo mật. Các công cụ này thường được bán với giá từ 70 đến 1.700 USD.

Một ví dụ cụ thể là WormGPT, một công cụ AI được thiết kế để tạo ra các email lừa đảo, mã độc và tìm lỗ hổng bảo mật. WormGPT được quảng bá trên các diễn đàn web đen với khả năng tự động hoá các hoạt động tội phạm mạng, bao gồm gửi email lừa đảo và viết mã độc. Một trong những khách hàng của WormGPT đã sử dụng nó để giả mạo ngân hàng và thu thập mã OTP từ các nạn nhân.

Triển khai các trò lừa đảo tiền mã hóa và thông tin sai lệch quy mô lớn

AI có thể tạo ra và lan truyền các trang web lừa đảo một cách nhanh chóng và dễ dàng. Dịch vụ như NovaDrainer cung cấp các trang web lừa đảo cho các chi nhánh và chia sẻ lợi nhuận, đã nhận được hơn 2.400 loại token từ hơn 10.000 ví tiền khác nhau, có khả năng là từ các nạn nhân bị lừa đảo. Ngoài ra, AI cũng được sử dụng để tự động tạo ra các bài đăng trên mạng xã hội, giúp lan truyền thông tin sai lệch về các dự án tiền mã hoá.

Một ví dụ cụ thể là dịch vụ NovaDrainer, một nền tảng cung cấp dịch vụ lừa đảo dưới dạng một dịch vụ cho các chi nhánh và chia sẻ lợi nhuận. NovaDrainer tuyên bố sử dụng AI để xử lý các giao dịch và tạo ra các thiết kế trang web mới, tối ưu hóa cho SEO và thẻ meta. Dịch vụ này đã nhận được hơn 2.400 loại token từ hơn 10.000 ví tiền khác nhau, có khả năng là từ các nạn nhân bị lừa đảo.

Ngoài ra, các bot mạng xã hội cũng được sử dụng để lan truyền thông tin sai lệch về các dự án tiền mã hoá. Một ví dụ điển hình là mạng lưới bot FOX8, một mạng lưới bot trên Twitter đã sử dụng ChatGPT để tạo ra các bài đăng và phản hồi tự động. Mạng lưới bot này bao gồm hơn 1.100 tài khoản và đã lan truyền các thông tin sai lệch về tiền mã hoá, với hashtag #crypto xuất hiện hơn 3.000 lần trong các bài đăng của mạng lưới này.

Mở rộng thị trường bất hợp pháp

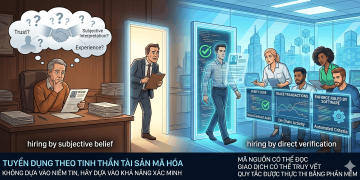

Trên các thị trường web đen, đã xuất hiện các dịch vụ AI tạo ra hình ảnh nude giả mạo của các người nổi tiếng và cung cấp các công cụ AI để tạo ra hình ảnh này với chi phí thấp. Các dịch vụ tạo tài liệu giả mạo như “OnlyFake Document Generator” sử dụng AI để tạo ra các giấy tờ tùy thân giả nhằm vượt qua các kiểm tra KYC tại các sàn giao dịch tiền mã hoá. Ngoài ra, các công cụ AI còn được sử dụng để lọc và phân tích dữ liệu bị đánh cắp từ các cuộc tấn công mạng.

Một ví dụ điển hình là OnlyFake Document Generator, một dịch vụ tạo tài liệu giả mạo sử dụng AI để tạo ra các giấy tờ tùy thân giả nhằm vượt qua các kiểm tra KYC tại các sàn giao dịch tiền mã hoá. Dịch vụ này cung cấp các gói dịch vụ từ 15 USD (tạo ra một tài liệu giả) đến 1.500 USD (tạo ra 1.000 tài liệu giả). Chỉ trong một tháng, dịch vụ này đã bán được đủ giấy phép để tạo ra khoảng 4.935 tài liệu giả.

Các dịch vụ tạo hình ảnh nude giả mạo của các người nổi tiếng cũng đã xuất hiện trên các thị trường web đen. Một ví dụ là một dịch vụ AI tạo ra hình ảnh khoả thân giả mạo của ít nhất 13 người nổi tiếng trong ngành giải trí Hồng Kông, được bán với giá 2 USD. Ngoài ra, các dịch vụ AI khác còn cung cấp khả năng tạo ra hình ảnh nude từ các hình ảnh do người dùng tải lên với chi phí thấp, thường dưới 1 USD mỗi hình ảnh.

Hệ lụy và biện pháp phòng ngừa

Sự kết hợp giữa AI và các hoạt động bất hợp pháp trên dark web đặt ra thách thức lớn cho các cơ quan thực thi pháp luật và chuyên gia an ninh mạng. Việc phát hiện và ngăn chặn các hoạt động này đòi hỏi sự hiểu biết sâu rộng về công nghệ AI và các phương pháp tội phạm mới.

Để đối phó với các mối đe dọa tội phạm được hỗ trợ bởi AI trong hệ sinh thái tiền mã hoá, cần thiết lập các biện pháp phòng ngừa toàn diện. Một trong những phương pháp tiếp cận này là DECODE, bao gồm các yếu tố sau:

1. Detection (Phát hiện): Sử dụng công nghệ AI để phát hiện sớm các hoạt động bất thường và các dấu hiệu của hành vi lừa đảo. Các hệ thống giám sát tự động có thể quét các giao dịch và các hoạt động trên chuỗi khối để tìm kiếm các mẫu hành vi đáng ngờ.

2. Education (Giáo dục): Tăng cường nhận thức và giáo dục cho người dùng và các bên liên quan về các rủi ro liên quan đến tội phạm AI trong tiền mã hoá. Các chiến dịch truyền thông và đào tạo nên được triển khai để giúp người dùng nhận biết các dấu hiệu lừa đảo và các biện pháp bảo vệ cá nhân.

3. Collaboration (Hợp tác): Thúc đẩy sự hợp tác giữa các cơ quan thực thi pháp luật, các công ty công nghệ và các tổ chức tài chính để chia sẻ thông tin và phối hợp trong việc đối phó với tội phạm AI. Sự hợp tác quốc tế cũng là yếu tố quan trọng trong việc đối phó với các mối đe dọa xuyên quốc gia.

4. Oversight (Giám sát): Thiết lập các cơ chế giám sát và quy định để đảm bảo rằng các công ty và các tổ chức tuân thủ các tiêu chuẩn bảo mật và phòng ngừa tội phạm. Các cơ quan quản lý nên thường xuyên cập nhật các quy định để phản ánh các xu hướng tội phạm mới.

5. Defense (Phòng thủ): Áp dụng các biện pháp bảo mật tiên tiến, bao gồm mã hóa, xác thực hai yếu tố và các giải pháp bảo mật khác để bảo vệ hệ thống khỏi các cuộc tấn công. Các biện pháp này cần được cập nhật liên tục để đối phó với các mối đe dọa mới.

6. Evaluation (Đánh giá): Thực hiện các cuộc kiểm tra và đánh giá thường xuyên về các biện pháp phòng ngừa tội phạm và các hệ thống bảo mật để đảm bảo tính hiệu quả. Các đánh giá này nên bao gồm cả việc thử nghiệm các hệ thống chống lại các cuộc tấn công giả lập để phát hiện và khắc phục các điểm yếu.

Kết luận

AI đang mở ra những cơ hội mới cho cả lợi ích và rủi ro trong hệ sinh thái tiền mã hóa. Việc hiểu rõ và quản lý các rủi ro liên quan là rất quan trọng để bảo vệ người dùng và duy trì an ninh mạng. Những nỗ lực phối hợp và các biện pháp phòng ngừa hiệu quả sẽ giúp giảm thiểu tác động của các hoạt động tội phạm này và bảo vệ sự phát triển bền vững của công nghệ AI và tiền mã hóa.

Báo cáo của Elliptic không chỉ cung cấp cái nhìn sâu sắc về các xu hướng tội phạm liên quan đến AI mà còn đề xuất các chiến lược cụ thể để đối phó với những thách thức này. Việc tiếp tục nghiên cứu và nâng cao nhận thức về các mối đe dọa tiềm ẩn là bước quan trọng trong việc đảm bảo một môi trường kỹ thuật số an toàn và đáng tin cậy.

Khi công nghệ tiếp tục tiến bộ, việc duy trì sự cân bằng giữa đổi mới và an ninh sẽ là một thách thức không nhỏ. Các bên liên quan trong ngành công nghiệp tiền mã hóa và công nghệ thông tin cần phải hợp tác chặt chẽ để phát triển các giải pháp an ninh tiên tiến, đồng thời nâng cao nhận thức và kỹ năng để đối phó với các mối đe dọa mới. Sự phát triển bền vững và an toàn của công nghệ AI và tiền mã hóa không chỉ phụ thuộc vào các biện pháp kỹ thuật mà còn cần đến sự hợp tác toàn cầu và sự cam kết của tất cả các bên liên quan.